Mit jeder neuen Version von Adobe Photoshop gibt es nicht nur neue Funktionen, sondern auch neue Bugs und neuen Ärger. Manchmal entsteht der Ärger nicht mal durch die Bugs, sondern die korrekt arbeitenden Funktionen.

Was ist das Problem?

Mit Photoshop CS5 hat Adobe die Behandlung von IPTC-Daten geändert. Das betrifft auch Adobe Bridge CS5 und vielleicht Adobe Lightroom 3)

Diese IPTC-Informationen (IPTC CORE, IPTC-IIM, Legacy) werden bei CS5 jetzt im UTF‑8 Zeichensatz statt als 8Bit-ISO-Zeichensatz gespeichert. Im Grunde kein Problem. Schwierig wird es nur, wenn Sonderzeichen wie im Deutschen vor allem Umlaute wie ä,ö, ü oder das ß hinzukommen. Das Problem ist, dass Sonderzeichen in jedem Zeichensatz an einer anderen Stelle abgespeichert werden.

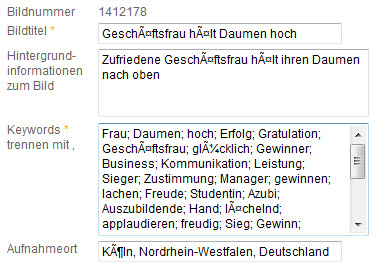

Wenn ein Programm oder eine Datenbank die Titel, Bildbeschreibungen oder Suchbegriffe aus den IPTC-Feldern ausliest, aber den benutzten Zeichensatz nicht abfragt, erkennt oder nutzen kann, führt das zu krpytischen Zeichen. In der Praxis sieht das dann zum Beispiel so aus:

Häßlich, nicht wahr? Außerdem führt das dazu, dass Bildkäufer die eigenen Fotos nicht finden, weil diese nie die kryptischen Zeichen eingeben werden.

Wer hat Schuld?

Wer hat Schuld am Problem? Adobe, weil es früher funktioniert hatte? Oder die Bildagenturen, weil sie die Daten nicht richtig importieren?

Technisch gesehen hat Adobe keine Schuld. Laut IPTC-Standard dürften für den alten Legacy IPTC-IIM-Standard nur ASCII-Zeichen verwendet werden, da sind nun mal keine Sonderzeichen dabei. Laut dem neuen XMP-Standard, in dem Adobe die Metadaten speichert, dürfen Sonderzeichen ausdrücklich benutzt werden und bei den meisten Bildagenturen klappt der Import auch.

Probleme machen vor allem einige deutsche Bildagenturen. Bei mir tritt das Problem bei diesen Agenturen auf:

- Bildmaschine

- Bildunion

- ImagePoint

- Digitalstock

Das bedeutet oft, dass deren Agentursoftware nicht die neuen XMP-Metadaten ausliest, sondern die ebenfalls immer automatisch mitgelieferten alten IPTC-Core-Metadaten.

Ich habe bei jeder Agentur nachgefragt und folgende Antworten bekommen:

- Bildmaschine kennt das Problem und versucht, mit der Einführung des neuen Fotografen-Backends auch den Metadaten-Import zu aktualisieren. Die Umstellung auf den neuen Fotografen-Bereich ist aktuell für Mai 2011 geplant.

- Bildunion antwortete kurz: „Wir kennen das Problem und werden das schnellstmöglich korrigieren.“

- Bei ImagePoint scheint zwar der Import die falschen Sonderzeichen anzuzeigen (siehe Screenshot oben), aber beim Durchlaufen des internen Prüfsystems werden die Daten neu berechnet und die Umlaute danach wieder korrekt angezeigt. Wir haben das mit einigen meiner Fotos getestet und es funktioniert.

- Digitalstock hat das Problem zur Kenntnis genommen, ist aber mehr damit beschäftigt reihenweise Bilder abzulehnen als sich um das Problem zu kümmern. Scherz beiseite: Digitalstock ist informiert und will sich darum kümmern. Viel Hoffnung habe ich jedoch nicht, dass es schnell geschehen wird.

Was ist die Lösung?

Naheliegend wäre, die Verschlagwortung einfach mit einem anderen Programm zu machen. Das ist aber keine Lösung, weil Photoshop bei einer nachträglichen Bearbeitung einer Datei wieder alle Metadaten im UTF8-Zeichenformat speichern würde. Im Idealfall würden alle betroffenen Bildagenturen den neuen XMP-Standard benutzen. Der kann übrigens theoretisch sogar die Model- und Property-Releases automatisch zuordnen. Den obigen Antworten nach sollte das bald geschehen sein. Bis dahin hilft nur ein Umweg.

Was ist die Notlösung?

Das kleine kostenlose Freeware-Programm ExifTool erlaubt zahlreiche Eingriffe in IPTC-Daten. Zum Beispiel kann damit vorgegaukelt werden, ein Foto wäre mit einer Hasselblad gemacht worden, obwohl es nur eine Canon war und ähnliches. In unserem Fall brauchen wir aber das Feature, was uns erlaubt, Zeichensätze umzuwandeln, genauer beschrieben in FAQ 10.

Bei mir sieht das konkret so aus: Ich habe mir das Programm exiftool.exe runtergeladen. Da es ein Kommandozeilen-Programm ist, kann ich eine Batch-Datei anlegen.Wie das geht? Ihr erstellt eine .txt-Datei, die genauso wie das Hauptprogramm heißt (also exiftool.txt) und schreibt darin:

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*

pause

Danach speichert ihr die Textdatei und benennt sie in „exiftool.bat“ um. Die bat-Datei und exe-Datei müssen im gleichen Ordner liegen. Wenn ihr jetzt eure JPG-Dateien im gleichen Ordner habt, müsst ihr sie nur auf die bat-Datei ziehen und das Programm wandelt den Zeichensatz zurück in das alte ISO-Format, mit dem alle Agenturen klarkommen. Wer etwas fitter mit Kommandozeilen ist, kann sich das Ganze auch anders oder bequemer programmieren. Den obigen „Pause“-Befahl habe ich nur eingefügt, damit ihr eine Bestätigung seht, dass alles korrekt konvertiert wurde. Wer Ahnung hat, kann das weglassen. Exiftool erstellt übrigens eine Sicherheitskopie von jeder umgewandelten Datei, ihr braucht also keine Angst zu haben, etwas unwiderruflich falsch zu machen.

Wie sieht es bei euch aus? Welche Erfahrungen habt ihr mit Umlauten gemacht? Welche Agenturen bereiten Probleme? Welche Lösungen habt ihr für euch gefunden?

(Danke an ManfredG für seine Hinweis in diesem Thread)

Kenne das eigentlich nur so, dass Sonderzeichen in IPTC Tags nichts verloren haben.

@Stefan: Früher ja, heute laut XMP-Standard eben nicht mehr. Und es gibt genug Bildagenturen, die „ue“ nicht in „ü“ umwandeln etc und die meisten deutschen Bildkäufer suchen nun mal mit Umlauten.

Hallo Robert!

Ja das kenne ich. Bei Fotocent habe ich auch diese Probleme seitdem ich CS5 verwende. Danke für den Tipp. Ich habe bisher diese Zeichen umständlich ausbessern müssen.

Schöne Grüße

Daniel

Hallo,

stimmt… wir hatten einige Probleme mit der korrekten Übernahme der Daten. Inzwischen sollte es aber funktionieren. Sollten dennoch Probleme auftauchen, wäre eine kurze Info an uns hilfreich. Ausserdem werden von uns die Begriffe kontrolliert, also auch fehlerhaft Zeichen von uns korrigiert.

Aber danke an Daniel, dass Du Dir die Mühe gemacht hast und Deine Begriffe schon vorher korrigiert hast, leider machen das die wenigsten Fotografen … übrigens auch was Rechtschreibfehler angeht.

Viele Grüße,

Olaf (von fotocent.de)

„Wie sieht es bei euch aus? Welche Erfahrungen habt ihr mit Umlauten gemacht?“

Umlaute und andere Sonderzeichen kommen mir nicht in IPTC-Header. (Übrigens auch nicht in Betreff-Zeilen von E‑Mails, Dateinamen usw.)

Einfacher ASCII-Zeichensatz – das versteht jede Software und jede Datenbank richtig.

Dazu Beschlagwortung und Bildbeschriftung deutsch und englisch.

Da habe ich gleich eine Frage zu den Exiftools. Ich wollte schon einmal mit Hilfe eines Scripts die Stichwörter durchsuchen und Wortteile austauschen. Daran bin ich kläglich gescheitert. Jetzt möchte ich gleich fragen: Hat jemand eine Idee wie ich das angehen könnte?

Ich habe eine Serie verschlagwortet zB. d:Tisch, e:Desk, d:Schreibtisch usw.

Ich würde gerne per Script die Sprachkennungen d: und e: durch nichts ersetzten.

Geht das?

@Max: Exiftool kann einzelne Keywords ersetzen, löschen oder hinzufügen. Aber da das „d:“ z.B. ja nur ein TEIL eines Keywords ist, weiß ich nicht, ob das auch ersetzt oder gelöscht werden kann. Am besten fragst Du einfach im exiftool-Forum: http://u88.n24.queensu.ca/exiftool/forum/

Sind eure Fotos bei der Bildmaschine seit dem Relaunch auch alle auf redaktionell gesetzt !?

Wenn ja, dann müsst ihr jedes einzelne Foto neu bearbeiten !

Die Massenbearbeitung geht nicht !

Oder habt ihr da schon Lösungen gefunden dafür ?

@Chris: Das hatte ich schon beim Beta-Test bemängelt, aber anscheinend wurde noch keine Batch-Funktion o.ä. implementiert.

Inzwischen wurde dieses Problem in der neuen Bildmaschine behoben. Generell gilt für Suchen in der Bildmaschine, dass Umlaute, egal ob als „ü“ oder „ue“ geschrieben, gleichermaßen gefunden werden. Wir wünschen weiterhin erfolgreiches hochladen und verkaufen!

Das Bildmaschine-Team

Hallo Robert,

das Problem mit den Umlauten und der Recodierung mittels exiftool ist leider sehr komplex. Laut Aussagen von Phil Harvey, dem Autor von exiftool wird der codedcharacterset nur von wenigen Programmen beim Speichern korrekt gesetzt und so weit ich herausgefunden habe, auch nur der codedcharacterset=UTF8 bei einigen Adobe-Programmen und bei PhotoMechanic.

Dein Code in der Batch-Datei greift daher nur, wenn in dem Bild der codedcharacterset=UTF8 auch tatsächlich gefunden wird.

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*

exiftool ist aber so per Default eingestellt, das ohne dieses Flag von LATIN1 ausgegangen wird. D.h., dass Bilder mit UTF8-Kodierung ohne dieses Flag NICHT konvertiert werden, da exiftool davon ausgeht, das es keinen Sinn macht, von LATIN1 nach LATIN1 zu rekodieren.

Da seit Lightroom 3.4 Adobe auf das Setzen dieses Flags verzichtet (lehnt sich dabei an die Empfehlungen der MWG (Metadata Working Group)) klappt die Konvertierung mit diesen Bildern nicht mehr. Vorher ging es. Bei CameraRAW (ab Vers. 6.4 ??) halten sie es ebenso. Bei PS CS4 + 5 klappt es noch. Wahrscheinlich werden die anderen Adobe Produkte aber ebenfalls bald angepaßt.

Der Trick mit exiftool betseht nun darin, erstmal den codedcharacterset korrekt zu setzen.

1. Schritt

exiftool ‑tagsfromfile @ ‑iptc:all ‑charset iptc=utf8 ‑codedcharacterset=utf8 %*

2. Schritt

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*

Im 2. Schritt kommt dann Dein Code zum Tragen und UTF8 wird korrekt nach LATIN1 recoded.

ABER ACHTUNG!!! Man muß ganz sicher sein, das wirklich schon UTF8 im Bild ist, sonst gibt es Zeichensalat. DAHER AM ANFANG IMMER mit Kopien arbeiten

Der gleiche Trick gilt für Lightroom-Versionen vor der 3er Serie. Hier wurde auf dem MAC der Zeichensatz MAC ROMAN benutzt. Hier sehen meine verkürzten Batchdateien so aus

1. Schritt recoded MAC ROMAN nach UTF8

exiftool ‑tagsfromfile @ ‑iptc:all ‑charset iptc=Mac ‑codedcharacterset=utf8 %*

2. Schritt recoded UTF8 nach LATIN1

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*

Meine generelle Lösung zur Zeit ist, das ich alle Bilder in UTF8, unabhängig ob der codedcharacterset korrekt gesetzt ist oder nicht, den codedcharacterset mit exiftool auf UTF8 setzte und danach nach LATIN1 recode. Ich muß vor der Recodierung dann nur noch herausfinden, ob UTF8 oder MAC ROMAN enthalen ist.

Leider habe ich noch nicht herausgefunden (exiftool ist ziemlich schwer zu erlernen), wie man mit exiftool die 2 Schritte zu einem vereinigen kann. Da ich mit Hunderten von Bildern mehrerer Hundert Fotografen zu tun habe und die Probleme bei dem Versions-Wirrwarr von Adobe zunehmen, wäre dies für mich eine enorme Zeitersparniss. Vielleicht hat jemand eine Tipp.

Viele Grüße

Jörn

@Jörn: Vielen Dank für die ausführlichen Hinweise. Da werde ich dann sicher bei Photoshop CS6 drauf zurückkommen müssen 😉

Zu Deiner Frage: Für EXIFTOOL gibt es doch ein aktives Forum, dort könntest Du Deine Frage mal stellen (und ggf. Deine Antwort hier posten :-):

http://u88.n24.queensu.ca/exiftool/forum/index.php

Danke für die rasche Antwort.

Ich habe das Forum von Phil und auch das Forum auf CPAN intensiv abgegrast, ohne entsprechende Lösungsansätze gefunden zu haben. So wie ich Phil bzgl. seines Programms in einem Beitrag verstanden habe, gibt es keine direkte Umwandlung von z. Bspl. MAC ROMAN nach LATIN1, sondern nur den 2‑stufigen Weg, da auch Phil nicht erraten kann, welcher Zeichensatz vorliegt, wenn er nicht in codedcharacterset definiert ist. So wie ich ihn verstehe, ist er über die IPTC-Implementierung und die Verarbeitung in diversen Bild-Management-Programmen not amused.

Allein die Wechsel von Adobe in Lightroom: Bis Version 2 CharSet = MAC ROMAN, ab Vers. 3 dann UTF8 mit gesetzem Flag im codedcharacterset, ab Vers. 3.4 dann UTF8 ohne gesetztem Flag im codedcharacterset. Dito CamerRAW.

Bei den Bildern, die ich von Photographen bekomme, ist alles dabei. Photoshop in allen Versionen, Lightroom, Bridge, RAW-Converter, MAC-OS, WINDOWS-OS. Das Gemeine ist, das Bilder oft mit verschiedenen Programmen angefaßt wurden und kaum noch nachvollziehbar ist, welcher Zeichenmatsch aus welchem Programm kommt. Was für ein Chaos.

Mein jetziger Kenntnisstand ist, das das Ganze wohl nur über (unsichere) heuristische Textanalysen der Captions geht, deren Ergebnisse dann in einem PERL-Script unter Verwendung von exiftool eingebaut werden müßte. Aber die Erörterung würde hier zu weit gehen.

Noch besser wäre natürlich, wenn alle Prgramme endlich in UNICODE/UTF8 arbeiten würden. Das gibt es nun schon über 20 Jahre.

Viele Grüße

Jörn

Nachtrag

Für Interessierte hier die 73-seitige PDF der MWG (MetaData Working Group)auf die sich Adobe seit Neuestem bezieht. Zum Teil schwer verdaulich!

http://www.metadataworkinggroup.org/pdf/mwg_guidance.pdf

Gruß

Jörn

@Jörn, ach so, das Problem sollte doch leicht zu lösen sein.

Du erstellst eine Batch-Datei namens – meinetwegen – konvertierung.bat, darin stehen dann drei Zeilen (ohne die Anführungszeichen):

„exiftool ‑tagsfromfile @ ‑iptc:all ‑charset iptc=utf8 ‑codedcharacterset=utf8 %*

pause

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*“

Die zu bearbeitenden Dateien sowie EXIFTOOL und die Batch-Datei müssen alle im GLEICHEN Verzeichnis liegen.

Wenn Du dann die Batch-Datei startest, sollte das Programm erst den einen Befehl ausführen und danach nach dem Drücken einer beliebigen Taste automatisch die zweite Umwandlung vornehmen.

Dank Dir für den Vorschlag, Robert.

Aber leider entspricht er genau meinem bisherigen Ablauf wie oben in meinem Posting mit den 2 Schritten beschrieben. Bei Tausenden Bildern dauert es halt sehr lange, wenn der Job 2mal laufen muß. Ich suche etwas in Form einer Pipe, wo die beiden Recodierungen quasi in einem Rutsch durchgeführt werden können und die Bilder nicht 2mal aufgerufen werden müssen. Ich habe auf Dein Anraten diese Frage aber heute auch an Phil geposted. Mal sehen ob einen Rat weiß. Falls ja, poste ich ihn hier.

Besten Dank

Jörn

Update:

Und hier die Antwort von Phil Harvey:

Zitat:

And each of these steps involves 2 stages, reading and writing, since you are using ‑tagsfromfile. You can avoid one read stage in the 1st step by doing this:

exiftool ‑codedcharacterset=utf8 a.jpg

Zitatende

Das heißt, aus meinem obigen Posting der

1. Schritt

exiftool ‑tagsfromfile @ ‑iptc:all ‑charset iptc=utf8 ‑codedcharacterset=utf8 %*

wird jetzt zu

exiftool ‑codedcharacterset=utf8 %*

Der 2. Schritt läßt sich nicht vermeiden

exiftool ‑tagsfromfile @ ‑iptc:all ‑codedcharacterset= %*

Zitat:

But I can see no way to avoid the 2nd stage since you can’t current specify a different default „-charset IPTC=“ for reading and writing, and neither the original nor the final files specify a CodedCharacterSet to override this.

Zitatende

Damit wird die Perfomance der Recodierung zumindest gesteigert, da ein READ-stage der Bilder vermieden wird.

Viele Grüße

Jörn

@Jörn: Danke für das Update.

Ein hoffentlich hilfreicher, wenn auch nicht erfreulicher Hinweis von der IPTC:

Wie in der Diskussion vermutet wird, liegt das Übel beim „codescharacterset“. Im IPTC IIM Format gibt es ein Feld (interne Kennung 1:90) in dem angegeben werden sollte, welcher Zeichensatz verwendet wird. Leider bleibt dieses Feld seit der Markteinführung von IIM im Jahr 1994 praktisch bei allen Bildbearbeitungsprogrammen leer, erst die Adobe CS 5 Programme setzen hier den richtigen Wert.

Das Ergebnis: Das die Metadaten lesende Programm kann nicht wissen, welcher Zeichensatz beim Schreiben verwendet wurde und nimmt an, das es der gleiche wie der aktuelle auf dem lesenden Computer ist. Probleme treten auf, wenn zwischen Windows und MacOS oder dem regionale Zeichensatz (z.B. West-/Osteuropa)beim Schreiben und dann Lesen gewechselt wird.

Viele Grüße

Michael

(IPTC GF und Leiter der Foto-Metadaten Aktivitäten)

Ich arbeite im Bereich Pressfotografie für verschiedne Agenturen und nutze Photo Mechanic zum Eintragen der IPTC Daten. Bei englischsprachigen Agenturen hat sich das Problem mit den Umlauten logischerweise noch nicht ergeben. Allerdings wurde jetzt auch alle Fotografen einer deutschen Agentur pauschal dazu aufgefordert keine Umlaute zu verwenden, da dieses in den Redaktionssystemen von Zeitungen zu dem beschrieben Problem mit den kryptischen Zeichen führt. Im Endeffekt haben die Zeitungen keine Lust sich damit rumzuschlagen was zu weniger Verkäufen führt. Eigentlich dachte ich, dass Photo Mechanic mit der Einstellung Unicode und Latin1 in dieser Hinsicht unproblematisch wäre. Bei anderen deutschen Agenturen gab es das Problem bisher nicht oder wurde zumindest nicht als solches erkannt oder angesporchen. Es ist schon ziemlich umständlich sich verschiedene Workflows für die einzelne Agenturen zu verinnerlichen bzw. technisch umzusetzen, besonders wenn man zeitgleich Bilder an zwei oder mehrere Agenturen liefern muss. Eigentlich bin ich kein Freund der „ae, ue, oe“ Schreibweise und will sie vermeiden. Weiß hier jemand etwas genaueres wie Photo Mechanic in dieser Hinsicht arbeitet und ob auch hier kryptische Zeichen generiert werden?

Ich stoße nach Jahren auf diesen Thread und habe im Prinzip das gleiche Problem, allerdings mit Photoshop Elements Organizer Version 12. Das Coded Char Set ist, wie von Michael Steidl am 27.10.2011 geschrieben, schon seit 20 Jahren definiert, wird weder gesetzt noch ausgewertet. Das ist sehr häßlich und sollte m.E. auch dringend korrigiert werden. Ich hab das bei Adobe reportet (http://feedback.photoshop.com/photoshop_family/topics/pse_organizer_destroyes_umlaut_in_iptc_coded_character_set_is_not_used) und bin anscheinend der einzige, der dieses Problem hat. Das mag ich nicht glauben. Vielleicht sagen ja noch mehr Personen, dass sie dieses Problem haben und schon bewegt sich der Riese – vielleicht.